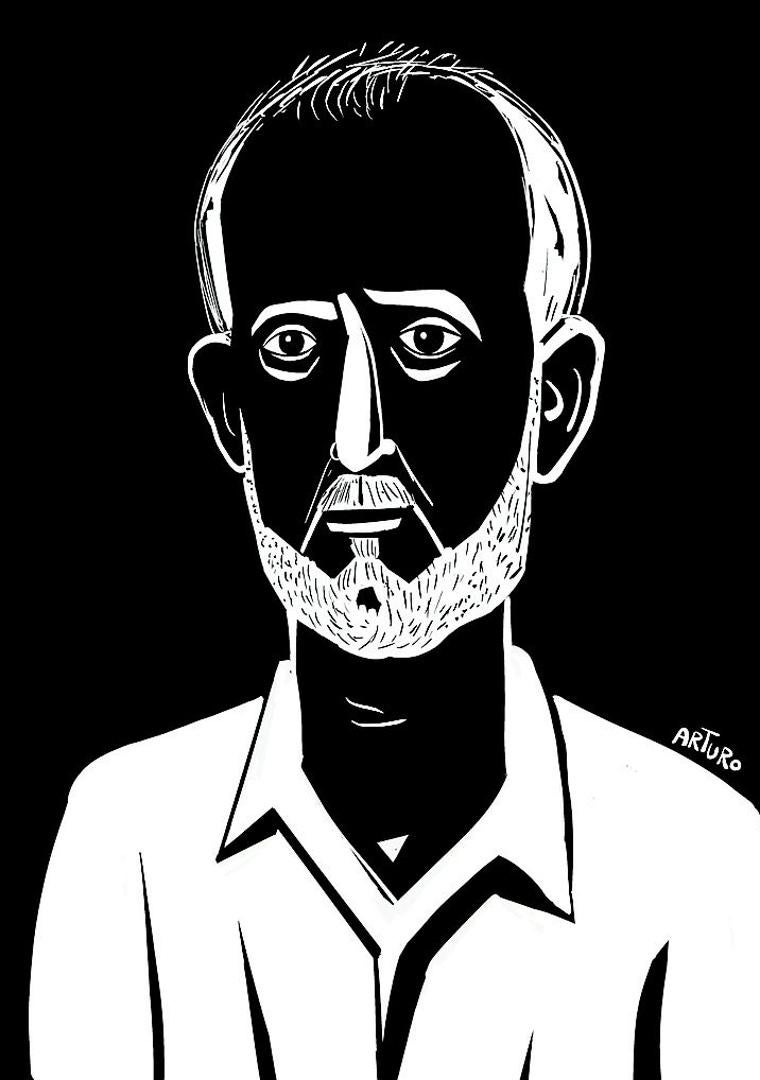

El filósofo Daniel Innerarity (Bilbao, 1959), incluido en la lista de los 25 grandes pensadores del mundo por ‘Le Nouvel Observateur’, cierra este lunes en Murcia esta temporada del Aula de Cultura de LA VERDAD y la Fundación Cajamurcia. Será a partir de las 19 horas, con acceso libre. Ganador del Premio de Ensayo Eugenio Trías por ‘Una teoría crítica de la inteligencia artificial’ (Galaxia Gutenberg), Innerarity hará una de las primeras presentaciones de este monumental ensayo en Murcia. Está muy contento. «Porque ha sido un trabajo intenso, es el libro más extenso que he escrito». Y, además, sobre un tema, la inteligencia artificial, «que no me era muy familiar, y para el que he tenido que estudiar mucho para no decir tonterías». No le gusta «para nada» la idea del filósofo que entra como un elefante en una cacharrería y moraliza y dogmatiza. «Por eso este libro tiene un gran aparato crítico, he leído a muchos técnicos e ingenieros». Y casi 80 páginas de bibliografía de las 550 que tiene. Se refiere a Eugenio Trías como «el gran filósofo de la Transición, si es que podemos hablar de ese periodo como un periodo filosófico que no tiene mucho que ver con las eventualidades políticas. No lo traté mucho, pero le tuve gran admiración y afecto», pone por delante, bromeando con que se podría haber doctorado con este ensayo en Ciencias de la Computación.

‘Una teoría crítica de la inteligencia artificial’ conecta con un hilo de su investigación desde siempre: la complejidad. Innerarity es catedrático de Filosofía Política, investigador Ikerbasque en la Universidad del País Vasco, director del Instituto de Gobernanza Democrática y titular de la Cátedra Inteligencia Artificial y Democracia del Instituto Europeo de Florencia, además de colaborador y articulistas de los diarios del grupo editorial Vocento, al que pertenece LA VERDAD.

Presentación en el Aula de Cultura de Daniel Innerarity

-

Día.

Lunes 16 de junio. -

Hora.

19.00. Entrada gratuita hasta completar aforo. -

Dónde.

Aula de Cultura deLA VERDAD y Fundación Cajamurcia. Gran Vía, 23. Murcia.

«Hace 30 años -cuenta mientras espera en Barajas el avión que le lleva a Florencia- tuve la intuición de que las instituciones políticas, y las formas de gobierno y la propia democracia, no estaban a la altura de la complejidad del mundo contemporáneo. Y empecé a estudiar esa complejidad en diversos aspectos en el tiempo y el espacio, en Europa, en el conocimiento y en la gobernanza global. Desde hace unos años sentía que me faltaba un gran elemento de complejidad: la tecnología y su función en las formas de gobierno». Esto debía haber sido un libro, que inicialmente pensó en titular ‘Filosofía política de la inteligencia artificial’, porque le interesaba focalizarse en ese aspecto, pero esa es la tercera parte del ensayo, y cuando la tenía escrita se dio cuenta de que eso lo tenía que fundamentar en una reflexión acerca de la relación humanos-matrix. Y cuando la terminó entendió que, o entraba a fondo en la cuestión de la inteligencia y la peculiaridad de la inteligencia humana, y lo que nos distingue de las máquinas, «o todo esto no se sostenía, de modo que he escrito el libro de atrás hacia adelante». Y este es el resultado.

-Y cabe preguntarse si hemos de ser pesimistas ante el presente y futuro de la democracia. Usted habla de cierta histeria, exageración, simplificaciones. Todo esto afecta negativamente a la comprensión de la IA.

-La inteligencia artificial, en relación con la democracia, ha generado dos sentimientos y dos discursos contrapuestos, pero que tienen algo en común. Me refiero al miedo y a la expectativa excesiva. Ambos tienen en común una falta de reflexión, o una insuficiente reflexión acerca de cuál es el alcance de los procedimientos de la gobernanza algorítmica para la consecución de objetivos políticos, que yo creo que es limitada. Los algoritmos nos pueden ayudar en la toma de decisiones, y me pregunto en qué medida eso se puede considerar un elemento importante de la configuración de una democracia, y cuáles son los límites de esa gobernanza algorítmica.

Fuera del radar

«La crisis económica, la pandemia, el Brexit, el ascenso fortísimo de las extremas derechas… nos ha sorprendido muchísimo todo eso. Esto dice muy poco de nuestro sistema de reflexión acerca del porvenir»

-¿La democracia de los datos puede ser más representativa que cualquier otro modelo de democracia en la historia?

-Eso lo dice gente, no lo digo yo. Es un eslogan, una narrativa que lanzan ciertas personas y a la que yo en el libro planteo unas limitaciones. Porque los datos son muy importantes, a la hora de reflejar nuestras referencias e intereses, pero tienen también muchas limitaciones. Fundamentalmente que los datos tienen que ser correctamente interpretados. De alguna manera, los datos solo nos representan si nosotros los insertamos en contextos de interpretación. Ocurre lo mismo que en la deliberación democrática normal, hay gente planteando datos para terminar un debate y los datos por sí mismos tienen poco valor, tienen un valor limitado en la política. Porque los humanos discutimos acerca de cómo interpretamos esos datos.

–Nos cita términos que nos resultan cada vez más familiares, como el populismo tecnológico, o el tecnoautoritarismo. Hay toda una terminología relacionada con el uso y abuso de la IA, que, en realidad, es la misma que se emplea para valorar la democracia.

-Nos encontramos en un momento muy curioso, en el cual hay toda una serie de tecnosolucionistas que están planteando soluciones tecnológicas a problemas políticos. Estoy pensando en el entorno de Trump. En cómo se han configurado unos señores, tecnólogos, unos señores feudales de la tecnología, que hace mucho tiempo que dijeron que la democracia no era el ámbito adecuado para resolver los grandes problemas que tiene la humanidad. Y pensaron que si prescindíamos de los formalismos y procedimientos democráticos tendríamos más innovación, más rapidez, más eficacia, más inmediatez. Esta es hoy en día, a mi juicio, la gran batalla que tiene hoy día la defensa de la democracia: cómo defender que la democracia sigue siendo, no solo un sistema superior desde el punto de vista normativo, sino desde el punto de vista de la adopción de decisiones inteligentes. Una democracia es un sistema en el cual hay libertad de información, circulación de la crítica, y todo eso genera un contexto en el cual es más difícil que nos equivoquemos que en un sistema autoritario. Estos sistemas feudales, en el fondo, quieren ir muy rápido, quieren que no haya regulación, porque no quieren que se pregunte a la gente, a los afectados por las decisiones, ni que sean de alguna manera protagonistas de esas decisiones. Cosa que es el principio nuclear y normativo de la democracia. Yo sostengo que esos procedimientos de la deliberación, de la discusión, del debate… nos ayudan. Puede parecer un engorro para el que tenga mucha prisa y exceso de certezas, pero en el fondo no son una garantía absoluta, pero por lo menos sí son algo que hace más verosímil que las decisiones que tomamos sean correctas y, sobre todo, que sean democráticas.

-Dice que tenemos que temer más a la estupidez humana que a la inteligencia de las máquinas.

-Es que los humanos y las máquinas somos estúpidos en distintas formas y para distintos asuntos. Los humanos nos solemos equivocar en una serie de cuestiones, tenemos unos sesgos muy específicos y muy bien estudiados, y las máquinas tienen otros sesgos que felizmente no coinciden con los nuestros. Lo cual nos permite pensar en una combinación productiva entre su habilidad y las nuestras. Un ejemplo de esto es que los humanos decidimos relativamente bien cuando hay pocos datos, cuando hay ambigüedad, cuando hay incertidumbre, cuando las soluciones no son binarias. En cambio, las máquinas deciden bastante bien en todo lo contrario: cuando hay un montón de datos, cuando no hay ambigüedad, hay poca incertidumbre. Mi propuesta es generar un ecosistema humanos-máquinas, que aproveche lo mejor de unos y de otros, y que corrija esos posibles sesgos que son, repito, bastantes diferentes.

-Recuerda a los primeros profesores que le hablaron de cómo iba a ser el futuro tecnológico, es decir, el mundo de hoy. ¿Ya se anticipaban hace décadas estos derroteros por los que hoy andamos, o era difícil imaginar un mundo así, tan complejizado?

-El mundo, tal y como está ahora mismo, era bastante inimaginable hace unos pocos años. De hecho, la mayor parte de las crisis de este siglo, la crisis económica, la pandemia, el Brexit, el ascenso fortísimo de las extremas derechas… nos ha sorprendido muchísimo, no lo teníamos en nuestros radares. Esto dice muy poco de nuestro sistema de reflexión acerca del porvenir. Quizás porque estamos en una cultura política muy volcada sobre el presente, sobre lo inmediato.

El principal reto de la democracia

«La gran batalla es cómo defender que la democracia sigue siendo no solo un sistema superior desde el punto de vista normativo, sino desde el punto de vista de la adopción de decisiones inteligentes»

-¿A qué contribuye la filosofía?

-Lo que yo he intentado con ese nuevo ensayo es que la filosofía contribuya a serenar un poco los debates y a delinear bien los conceptos que estamos manejando. A los filósofos nos gusta prestar atención a lo latente, a las corrientes de fondo, donde pocas veces se mira desde los medios de comunicación y las instituciones políticas metidos en la batalla de lo inmediato. Una sociedad que se agita mucho parece que está cambiando muchas cosas, pero realmente es una agitación improductiva.

Informes para la UE y Unesco

-¿En qué proyectos están involucrados en este 2025 desde la Cátedra de Inteligencia Artificial y Democracia, que tiene su sede en San Sebastián y en el Instituto Europeo de Florencia?

-El objetivo es reflexionar sobre cómo afecta esta tecnología a la democracia, pero este año estamos muy comprometidos con asesorar, por un lado, al Consejo de Europa, que nos ha pedido un dictamen acerca de esta cuestión, las amenazas que la inteligencia artificial puede representar para la democracia. Y, por otro, con un informe para Naciones Unidas sobre el estado de la democracia en el mundo, en el cual hay una parte que tiene que ver con el impacto de la inteligencia artificial, y también hay otras cosas que estamos analizando. Ambas cosas las tendremos, más o menos, a finales de este año y principios del año 2026. Esto continúa el informe que hice para UNESCO sobre inteligencia artificial y democracia hace dos años.

«Las máquinas hacen bien su trabajo cuando los humanos deciden cuáles son los objetivos»

-¿Los errores algorítmicos son peores que los que puedan cometer los humanos por el hecho de multiplicarse aún más?

-Los errores forman parte de la vida humana y de la vida de los algoritmos. No hay algoritmo que no tenga errores. Los algoritmos aprenden y eso incluye fallos casi inevitables. La cuestión es siempre establecer mecanismos de corrección, y conocer los sesgos de humanos y máquinas, y establecer una corrección. Las intervenciones humanas en los algoritmos para corregir sus sesgos introducen a su vez nuevos sesgos, con lo cual toda la cuestión consiste en cómo establecer un sistema de retroalimentación en el que haya intervención humana y sesgos. Sesgos que sirvan para corregir errores humanos e intervenciones humanas que sirvan para corregir los errores de las máquinas.

-¿Cómo puede resolverse la cuestión de la desafección democrática que hoy es tan alta?

-La política no es reducible al momento de las elecciones, que es relativamente poco importante. Lo importante es lo que hay entre una y otra, y, sobre todo, dos cuestiones para las que nos pueden ayudar las máquinas, y también nos pueden generar problemas: la conversación y la decisión. La conversación hoy en día está mediada por algoritmos a través de las redes sociales, y esto no lo hemos conseguido regular bien, pues genera muchas asimetrías y muchos problemas. Y ha contribuido a degradar la conversación pública, ha contribuido a empeorarla. Y lo segundo es la toma de decisiones, el buen gobierno. Y el buen gobierno incluye muchas cosas, entre otras la de una mayor objetividad, una mayor capacidad de medición de impactos en la toma de decisiones o en la legislación, y en esto las máquinas también nos ayudan. Pero la determinación de los objetivos a los cuales van a servir esas tecnologías es una determinación que tenemos que hacer los humanos. Las máquinas hacen bien su trabajo cuando los humanos hemos decidido cuáles son los objetivos.

Soy William Abrego, me uní como ejecutivo de SEO y me abrí camino hasta el puesto de Gerente Asociado de Marketing Digital en 5 años en Prudour Pvt. Ltd. Tengo un conocimiento profundo de SEO en la página y fuera de la página, así como herramientas de marketing de contenido y diferentes estrategias de SEO para promover informes de investigación de mercado y monitorear el tráfico del sitio web, los resultados de búsqueda y el desarrollo de estrategias. Creo que soy el candidato adecuado para este perfil ya que tengo las habilidades y experiencia requeridas.

Enlace de origen : Daniel Innerarity: «Los procesos de debate, deliberación, discusión... ayudan a la democracia»